В феврале 2025 года Алексей Руденко не смог попасть на работу.

Это не была драматическая сцена с полицейскими сиренами, взломом дверей или людьми в масках. Всё выглядело куда прозаичнее — а потому и страшнее.

Турникет на входе в логистический терминал коротко мигнул красным.

— Ошибка допуска, — сказал охранник, даже не подняв глаз.

Алексей попытался приложить пропуск ещё раз. Потом ещё.

Над воротами гудели промышленные лампы холодного света, пахло мокрым бетоном и машинным маслом. Где-то в глубине склада пищали электрокары.

Через двадцать минут ему сообщили, что его профиль временно ограничен внутренней системой безопасности компании. Ещё через три дня банк неожиданно запросил дополнительную проверку транзакций.

Через неделю страховая компания подняла стоимость полиса. А спустя месяц он узнал, что автоматическая HR-система другой фирмы отклонила его кандидатуру ещё до собеседования. Причина нигде не называлась прямо.

Позже выяснилось, что цепочка началась с аналитической системы, обнаружившей «аномальную модель поведения»: ночные поездки по окраинам города, участие в нескольких закрытых интернет-сообществах по криптовалюте и регулярное использование сервисов анонимизации.

Точка, в которой алгоритм перестаёт быть наблюдателем

Ни одного преступления Алексей не совершал. Но алгоритм решил, что он похож на человека, который потенциально способен их совершить.

Именно в этом сегодня заключается главный сдвиг в природе персональной безопасности. Раньше опасность приходила после поступка. Теперь — после прогноза.

Машина подозрения

Человечество уже проходило эпохи тотального контроля, и каждый раз людям казалось, что предел уже достигнут. В XIX веке тайная полиция европейских империй собирала досье на революционеров, студентов, журналистов и философов. В Австро-Венгрии, Российской империи и Пруссии существовали целые отделы, занятые перехватом писем, слежкой за трактирами и составлением психологических характеристик неблагонадёжных лиц. В XX веке государства научились создавать картотеки на миллионы граждан. Архивы Штази, советские базы наблюдения времён холодной войны, оперативные дела спецслужб — всё это воспринималось как вершина административного контроля над человеком.

Но у прежних систем был фундаментальный недостаток: им всегда требовался человек.

Человек наблюдал. Человек сортировал информацию. Человек уставал. Человек допускал ошибки. Даже самая жёсткая система прошлого упиралась в ограниченность человеческого внимания. Сотрудник мог не заметить деталь, аналитик мог неправильно интерпретировать данные, оперативник мог упустить подозреваемого из вида.

Современный алгоритм устроен иначе. Он не знает усталости, не нуждается в сне и не теряет концентрацию. Он анализирует одновременно миллионы цифровых следов, связывает события, которые человеческий мозг никогда не сопоставил бы вручную, и делает это непрерывно — двадцать четыре часа в сутки.

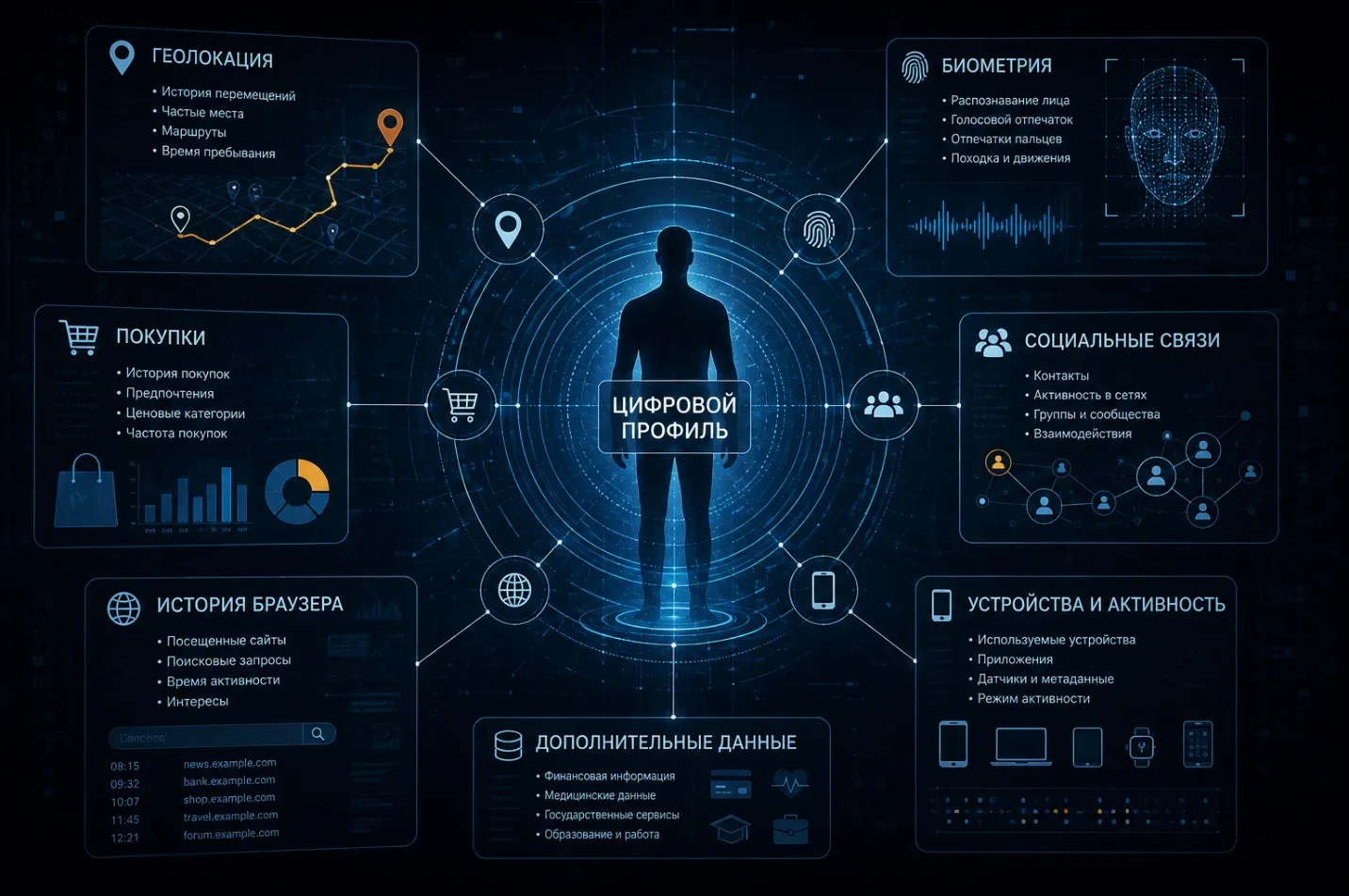

Сегодня цифровой профиль личности складывается из тысяч мелочей. Геолокация смартфона показывает привычные маршруты. История покупок говорит о финансовом положении и образе жизни. Манера печати текста позволяет определить эмоциональное состояние. Паузы между сообщениями формируют поведенческий ритм. Биометрия лица и тембр голоса становятся цифровым отпечатком человека. Даже угол наклона смартфона во время ходьбы способен использоваться как идентификатор.

Причём опасность заключается не столько в самих данных, сколько в связях между ними.

Обычный человек полагает, что его жизнь распадается на отдельные фрагменты: работа отдельно, покупки отдельно, социальные сети отдельно, навигатор отдельно. Алгоритм видит всё как единую картину. Для него нет разницы между банковской операцией, поздним звонком, маршрутом такси и комментарием в интернете. Всё превращается в элементы одного поведенческого узора.

В 2016 году исследователи Стэнфордского университета показали, что алгоритм способен определять психологические особенности человека по цифровому поведению точнее, чем коллеги по работе.

Что вычисляет камера, когда вы проходите мимо

Несколько лет спустя специалисты Университета Карнеги — Меллона представили модели, прогнозирующие риск финансового мошенничества по поведенческим паттернам задолго до самого инцидента. Это означает фундаментальную перемену. Современная система безопасности всё реже работает с прошлым. Она начинает работать с вероятностью будущего.

Именно здесь возникает новый тип конфликта. Не человек против преступника. Человек против алгоритма интерпретации.

Для системы будущего подозрение становится не юридической категорией, а статистической вероятностью. И это особенно опасно потому, что человек часто даже не знает, по каким критериям его оценивают.

Когда-то в средневековой Европе человек хотя бы видел своего обвинителя. В XXI веке обвинение постепенно становится невидимым. Его выносит не судья, не чиновник и даже не офицер спецслужбы. Его выносит математическая модель.

Социальный рейтинг без объявления войны

Когда сегодня говорят о цифровом контроле, большинство людей автоматически вспоминает китайскую систему социального рейтинга. Камеры наблюдения, распознавание лиц, баллы доверия — всё это давно стало привычным примером в журналистике и публичных дискуссиях. Это удобно. Далёкая страна, чужая политическая модель, экзотическая система государственного контроля. Но настоящая проблема заключается в другом. Механизм социального рейтинга уже существует почти везде — просто он распределён между банками, страховыми компаниями, логистическими платформами, HR-сервисами, государственными структурами и цифровыми корпорациями. Он не выглядит как единая система, однако работает именно как система.

Человек с плохой кредитной историей получает ограничения. Человек с подозрительной цифровой активностью проходит дополнительные проверки. Человек с нестандартным поведением вызывает интерес автоматических аналитических систем. Никто официально не называет это социальным рейтингом. Но суть остаётся прежней.

Современное общество постепенно движется к модели, в которой алгоритм начинает определять уровень доверия к личности ещё до того, как сама личность успевает что-то объяснить.

В Лондоне несколько лет назад проводился эксперимент по поведенческому прогнозированию пассажиропотока в метро. Система анализировала маршруты, задержки, плотность движения и аномальные отклонения. Первоначально речь шла исключительно о логистике и безопасности инфраструктуры. Однако очень быстро выяснилось, что подобные модели можно использовать не только для управления потоками людей, но и для анализа подозрительного поведения.

В США predictive policing уже применяется рядом полицейских департаментов. Алгоритмы рассчитывают районы повышенного риска и потенциально опасные паттерны активности. Сторонники таких систем утверждают, что технологии помогают снижать преступность и эффективнее распределять ресурсы полиции. И отчасти это действительно так. Но проблема состоит в другом. Алгоритм почти всегда наследует ошибки среды, на которой его обучали.

Граница между предиктивным и принудительным

Если система десятилетиями получала данные из районов с высоким уровнем преступности, она начинает видеть угрозу там чаще. Если определённая социальная группа чаще попадала в полицейские отчёты, система будет уделять ей повышенное внимание. Машина не знает справедливости. Она знает корреляцию.

История уже сталкивалась с похожими попытками превратить преступность в вычисляемую величину.

В конце XIX века итальянский криминолог Чезаре Ломброзо пытался определять склонность к преступлению по строению черепа и особенностям внешности. Его теория позже была признана псевдонаучной, однако сама идея «предсказуемого преступника» оказалась удивительно живучей. Только теперь вместо циркуля и линейки работают нейросети. Именно поэтому главный риск XXI века связан не с восстанием машин, как любят показывать фантасты. Куда опаснее другое. Мир, в котором человек постепенно привыкает к тому, что алгоритм знает о нём больше, чем он сам.

Человек как источник сырья

Старый промышленный капитализм добывал уголь, нефть, металл и древесину.

Новый цифровой капитализм добывает поведение. Каждое движение человека превращается в сырьё для аналитики. Смартфон сообщает о владельце больше, чем когда-либо знали соседи, коллеги и родственники вместе взятые. Причём большинство людей даже не представляет масштаб этого процесса. Когда человек просыпается утром и берёт телефон в руку, система уже начинает фиксировать десятки параметров. Время активации экрана. Скорость движения пальцев. Геолокацию. Уровень освещённости помещения. Частоту использования приложений. Продолжительность пауз между действиями. На первый взгляд всё это выглядит как технический шум. Но именно из такого шума строится цифровая модель личности.

По данным исследования Mozilla Foundation, значительная часть популярных мобильных приложений собирает гораздо больше информации, чем необходимо для их прямой функции. Телефон фиксирует скорость движения человека, режим сна, уровень активности, круг общения и привычные маршруты. Даже выключенный Bluetooth позволяет строить карту перемещения внутри зданий. Особенно ценными оказываются не сами разговоры и сообщения, а метаданные. Кто позвонил. Когда позвонил. Откуда. Как долго длился разговор. Как часто повторяется контакт. В какое время суток человек наиболее активен.

Бывший директор АНБ Майкл Хайден однажды произнёс фразу, ставшую почти афоризмом: «Мы убиваем людей на основе метаданных».

В этой фразе важна не военная сторона. Важно признание масштаба. Метаданные перестали быть техническим мусором. Они превратились в цифровой скелет личности.

Историки экономики любят говорить, что нефть стала главным ресурсом XX века. Но нефть хотя бы добывали из земли. Поведенческие данные человек добывает из самого себя. И парадокс современности состоит в том, что большинство людей делает это добровольно. Они публикуют маршруты путешествий. Передают биометрию. Документируют собственные привычки. Рассказывают алгоритмам о своих вкусах, страхах, политических взглядах и эмоциональных реакциях.

Никогда прежде цивилизация не создавала настолько подробный архив самой себя. В начале XX века разведывательные службы тратили годы на создание психологического портрета отдельного человека. Сегодня рекламная платформа может построить подобный профиль за несколько недель. Причём без допросов, слежки и вербовки агентов. Достаточно того, что человек сам носит устройство наблюдения в кармане. Именно поэтому персональная безопасность будущего всё меньше связана с классическим пониманием защиты. Проблема уже не только в том, могут ли ваши данные украсть. Проблема в том, что сама ваша личность постепенно превращается в объект непрерывного вычисления.

Deepfake и конец доверия

Почему оператор всё ещё нужен

Весной 2024 года финансовый сотрудник международной компании в Гонконге перевёл мошенникам около двадцати пяти миллионов долларов. Причиной стал видеозвонок. На экране находились его коллеги и руководство компании. Всё выглядело абсолютно достоверно. Голоса совпадали. Мимика совпадала. Интонации совпадали. Люди на экране обсуждали детали рабочих процессов, внутренние документы и финансовые операции компании. Проблема состояла лишь в том, что все участники конференции, кроме самого сотрудника, были сгенерированы искусственным интеллектом. Это событие стало символическим. Человечество вступило в эпоху, где больше нельзя безоговорочно доверять собственным глазам. На протяжении столетий цивилизация держалась на довольно простом принципе: увидеть означало убедиться. Фотография считалась доказательством. Видеозапись воспринималась как подтверждение факта. Голос человека был частью его личности. Теперь всё это начинает разрушаться.

Deepfake меняет саму природу доказательства. Когда-то мошеннику требовалось подделывать подписи и документы. Затем появились фальшивые фотографии. Сегодня достаточно нескольких минут видеозаписи и открытого программного обеспечения, чтобы создать убедительную цифровую копию человека. Особенно опасно то, что технологии синтетической реальности стремительно дешевеют.

Раньше качественная операция по дискредитации требовала ресурсов спецслужбы или крупной медиаструктуры. Теперь с подобной задачей способен справиться человек с ноутбуком и доступом к нейросети.

Но проблема deepfake значительно шире обычного мошенничества. Речь идёт о постепенном разрушении самого механизма общественного доверия. Если фотографию можно подделать, видео можно синтезировать, а голос можно скопировать, общество начинает терять основу для подтверждения реальности.

Историки технологий любят сравнивать цифровую революцию с изобретением печатного станка. Но, возможно, более точным будет другое сравнение. Deepfake — это момент, когда цивилизация теряет монополию на реальность. В ближайшие годы человечество, вероятно, столкнётся с новой формой информационной войны. Не войной за территории. Не войной за ресурсы. А войной за подлинность.

Представим ситуацию: в сети появляется видео, на котором политик объявляет о чрезвычайном положении. Или военный командир отдаёт приказ. Или крупный предприниматель признаётся в финансовых преступлениях. Даже если запись окажется фальшивкой, сам факт её появления уже способен вызвать последствия — панику, финансовый обвал, репутационное уничтожение. В этом заключается одна из самых опасных особенностей эпохи искусственного интеллекта.

Раньше ложь требовала времени. Теперь достаточно нескольких часов, чтобы синтетическая реальность начала влиять на реальные решения миллионов людей. И здесь возникает ещё один парадокс. Чем совершеннее становятся технологии подделки, тем меньше люди доверяют вообще чему-либо. Наступает эпоха, в которой человек вынужден сомневаться даже в очевидном. А общество, не способное отличить правду от качественной симуляции, становится чрезвычайно уязвимым.

Именно поэтому персональная безопасность будущего всё чаще будет связана не только с защитой данных, но и с защитой самой личности как доказуемой реальности.

Источники: Stanford University, psychometric analysis of digital behavior Carnegie Mellon University, behavioral fraud prediction systems Transport for London analytics reports Transport for London analytics reports Brennan Center for Justice; Chicago Crime Lab Mozilla Foundation, Privacy Not Included reports Интервью Michael Hayden, 2014 Hong Kong Police Force reports on deepfake fraud cases